자율주행과 로봇 산업에는 거대한 두 갈래의 길(Philosophy)이 있습니다. 하나는 지난 포스팅에서 다룬 **라이다(LiDAR)**를 활용해 정밀한 지도를 그리는 방식이고, 다른 하나는 오직 **카메라(Camera)**와 AI만으로 세상을 이해하는 방식입니다.

전 세계 자율주행의 선두 주자인 테슬라(Tesla)는 후자인 **’테슬라 비전(Tesla Vision)’**에 모든 것을 걸었습니다. 왜 일론 머스크는 값비싼 라이다 센서를 “바보들의 지팡이”라 부르며 카메라에만 집착할까요? 그 이유를 분석해 봅니다.

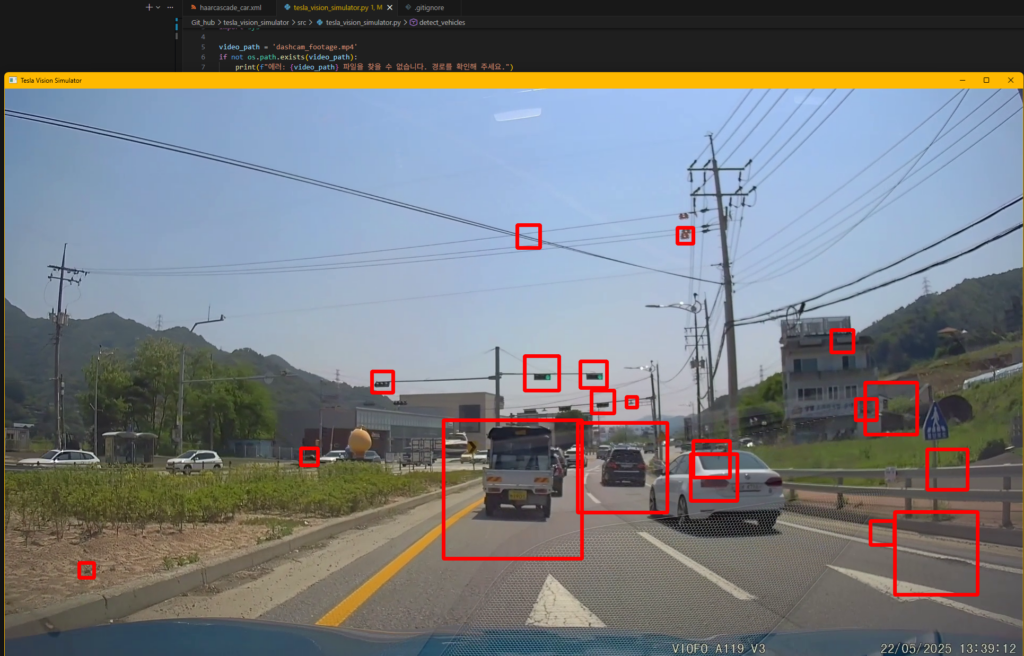

1. 인간의 운전 방식에서 답을 찾다

테슬라의 논리는 명쾌합니다. **”인간은 눈(카메라)과 뇌(AI)만으로도 운전을 아주 잘한다”**는 것입니다. 인간은 눈으로 거리를 완벽하게 측정하지 못해도, 경험과 지각을 통해 앞차와의 간격을 조절하고 돌발 상황에 대처합니다.

테슬라는 로봇(자동차)도 인간처럼 학습하면 된다고 믿습니다. 고가의 라이다 센서 없이도 카메라로 들어오는 2차원 영상을 AI가 3차원으로 재해석(Pseudo-LiDAR)할 수 있다면, 굳이 비싼 장비를 달 이유가 없다는 것이죠.

2. 왜 비전(Vision) 방식인가? (투자적/기술적 이유)

테슬라가 비전 방식을 고집하는 데는 아주 현실적인 이유가 숨어 있습니다.

① 압도적인 비용 절감

지난 글에서 언급했듯, 라이다는 수백만 원에서 수천만 원을 호가합니다. 반면 카메라는 개당 몇만 원 수준입니다. 하드웨어 비용을 획기적으로 낮추면 로봇과 자율주행차의 대중화 속도는 비교할 수 없을 만큼 빨라집니다. 이는 기업의 **수익성(Margin)**과 직결되는 문제입니다.

② 데이터의 양과 질

테슬라는 전 세계 도로를 달리는 수백만 대의 차량으로부터 매일 엄청난 양의 주행 데이터를 수집합니다. 라이다 데이터는 용량이 크고 복잡하지만, 영상 데이터는 AI(신경망)가 학습하기에 가장 적합한 형태입니다. 데이터가 쌓일수록 테슬라의 AI 뇌는 더 똑똑해지는 ‘선순환 구조’를 갖게 됩니다.

③ 디자인과 내구성

차체 곳곳에 튀어나온 라이다는 공기 저항을 일으키고 디자인을 해칩니다. 또한 물리적으로 회전하는 라이다보다 고정된 카메라가 고장 날 확률이 훨씬 적습니다.

3. 카메라 방식의 치명적인 약점과 해결책

물론 카메라만 쓰는 것이 완벽하진 않습니다. 카메라는 빛에 의존하기 때문입니다.

역광이나 안개: 햇빛이 너무 강하거나 안개가 끼면 카메라의 가시거리가 급격히 짧아집니다.

거리 측정 오차: 2차원 이미지만으로 물체와의 정확한 거리를 계산하는 것은 매우 고난도의 수학적 연산이 필요합니다.

테슬라는 이를 **’오큐판시 네트워크(Occupancy Network)’**라는 기술로 해결하려 합니다. 카메라가 찍은 영상을 3차원 공간의 ‘부피(Volume)’ 단위로 쪼개어, 비어있는 공간과 채워진 공간을 실시간으로 구분하는 방식입니다. 라이다 없이도 공간의 입체감을 살려내는 소프트웨어의 승부수입니다.

4. 로봇 산업으로 이어지는 ‘비전’의 미래

이 기술은 자동차에만 머물지 않습니다. 테슬라의 휴머노이드 로봇인 **’옵티머스(Optimus)’**도 머리에 카메라만 달려 있습니다. 로봇이 복잡한 집안 환경이나 공장에서 물건을 집고 옮기려면 인간과 유사한 시각 지능이 필수적입니다.

카메라 기반의 비전 기술이 완성된다면, 로봇은 별도의 지도 데이터 없이도 처음 가는 장소에서 즉시 활동할 수 있는 **’범용성’**을 갖게 됩니다.

마치며: 결국 소프트웨어가 하드웨어를 이길까?

현재 자율주행 업계는 ‘라이다+카메라’의 안정성을 택한 진영과 테슬라처럼 ‘오직 카메라’의 효율성을 택한 진영으로 나뉘어 있습니다.

하드웨어(라이다)의 가격이 먼저 떨어질까요, 아니면 소프트웨어(AI 비전)의 완성도가 먼저 정점에 도달할까요? 이 싸움의 승자가 미래 로봇 시장의 패권을 쥐게 될 것입니다.